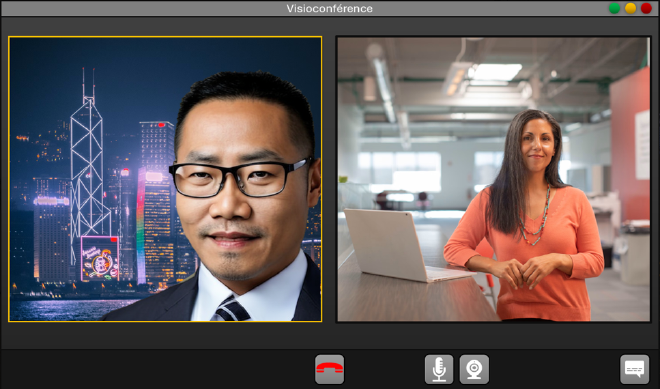

Vous êtes au bureau, et recevez une invitation de réunion de votre directeur basé dans un autre pays. Vous êtes surpris mais décidez d’y aller, pour voir. Les caméras s’allument, vous y retrouvez les visages familiers de vos collègues. Ils discutent entre eux puis le directeur financier vous demande de procéder à des virements bancaires, pour réaliser les opérations décrites juste avant.

Autant l’email pouvait paraître suspect, autant la visioconférence ne laisse aucun doute sur la légitimité des consignes, et vous faites les virements.

Et vous venez de vous faire avoir.

Histoire vraie

Cette scène s’est réellement passée, à Hong Kong, début 2024. L’entreprise victime n’a pas été nommée, la police locale a toutefois rapporté que la fraude se montait à 26 millions de dollars américains (200 millions de dollars hongkongais).

Les personnes semblaient plus vraies que nature.

C’est ce qu’on appelle un deepfake : « une technique de synthèse multimédia reposant sur l’intelligence artificielle »1 qui permet de générer automatiquement du contenu. Ici, les escrocs ont réutilisé des vidéos Youtube des différents salariés et demandé à l’IA de générer des vidéos avec les consignes.

Toujours selon la police hongkongaise, la visioconférence était totalement pré-enregistrée et il n’y a eu aucune interaction avec le salarié victime.

Fraude au président 2.0

Sur le principe, ce type d’attaque n’est pas nouveau et est largement connu sous le nom de Fraude au président. L’attaquant se fait passer pour une autorité de l’organisation (PDF, directeur financier…) et ordonne à un salarié de réaliser des virements ou transmettre des informations sous couvert du secret le plus absolu. Ces attaques se déroul(ai)ent principalement par emails, plus faciles à usurper.

Les organisations sensibilisent largement leurs personnels pour les identifier et les éviter car les dégâts peuvent être énormes. Cette formation a d’ailleurs porté ses fruits : le salarié pensa d’abord à une fraude en recevant l’email. Ce n’est que l’innovation de la vidéo qui l’a convaincu du contraire.

Prévention 2.0 ?

Nous allons devoir nous adapter face à l’évolution de la menace. Si la consigne générale reste la même, à savoir demander une confirmation par un autre canal en cas de doute, le seuil du doute vient de s’abaisser.

Sur cette attaque, on peut supposer que le salarié aurait pu découvrir le pot-aux-roses s’il était intervenu2 car les vidéos pré-enregistrées ne lui auraient évidemment pas répondu. Néanmoins, les techniques d’IA progressent rapidement et l’interactivité sera prochainement facilement disponible. Dès lors, si les emails peuvent être compromis, si la voix peut être compromise, et si l’image peut être compromise, comment authentifier l’instruction reçue ?

Il convient toutefois de pondérer cette menace, en tout cas pour l’instant. Les fraudes au président nécessitent une préparation spécifique : identifier une organisation-cible, le dirigeant, le salarié-cible… et maintenant retrouver des enregistrements audio et vidéo de ce dirigeant. Si je m’attends à voir de nouvelles fraudes par IA dans le futur, elles ne viseront probablement que de très grosses structures, pour lesquelles l’attaquant a bon espoir de pouvoir rentabiliser sa préparation.

Quels sont les signes d’une fraude au président ?

Le message :

- semble provenir d’un haut-dirigeant,

- demande un transfert d’argent ou d’information,

- insiste sur la confidentialité,

- exige une réaction rapide,

- indique que le dirigeant est injoignable pour le moment,

- peut être rédigé de manière inhabituelle, et ne pas suivre les procédures de l’organisation.

Il convient alors d’en référer à sa hiérarchie ou à l’équipe Sécurité de l’organisation.

Images Unsplash, IA et Cyril Amar

-

Deepfake. (2024, février 17). Wikipédia, l’encyclopédie libre. http://fr.wikipedia.org/w/index.php?title=Deepfake&oldid=212547286. ↩︎

-

Il n’est bien sûr pas question de lui jeter la pierre a posteriori : la nature de l’attaque, le contexte de l’entreprise, peut-être des acquis culturels ont joué contre lui. ↩︎